小米技术官方微博宣布,小米大模型团队在音频推理领域取得重大突破。受DeepSeek-R1启发,团队创新性地将强化学习算法应用于多模态音频理解任务。仅用一周时间,团队便以64.5%的SOTA(State Of The Art)准确率,荣登国际权威的MMAU音频理解评测榜,同时将相关技术开源共享。

MMAU(Massive Multi-Task Audio Understanding and Reasoning)评测集是衡量音频推理能力的关键标准,包含一万条语音、环境音和音乐样本,旨在评估模型在多种技能上的表现。人类专家在该评测集上的准确率为82.23%,目前榜单上表现最佳的模型为OpenAI的GPT-4o,准确率为57.3%,其次是Google DeepMind的Gemini2.0Flash,准确率为55.6%。

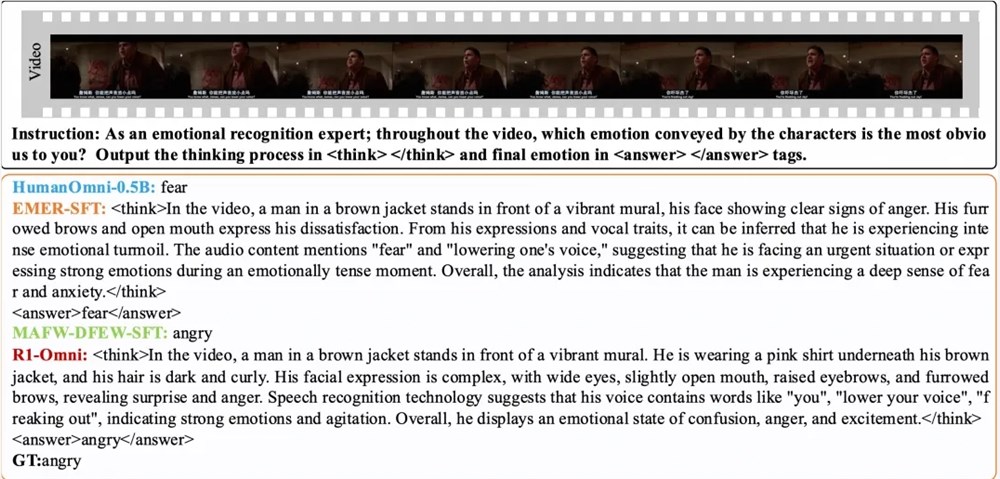

小米团队的研究起初使用清华大学发布的AVQA数据集进行微调,准确率达到51.8%。但在将DeepSeek-R1的Group Relative Policy Optimization(GRPO)算法应用于Qwen2-Audio-7B模型后,仅用AVQA的3.8万条训练样本就实现了64.5%的准确率,超越了现有商业模型。

研究发现,在训练过程中强制模型输出推理过程时,准确率反而下降至61.1%。这表明形式化的思维链输出可能不利于模型训练,强化学习的实时反馈机制更有助于模型锁定高质量答案的分布区域。尽管准确率已有显著提升,但与人类专家水平仍有一定差距。

小米大模型团队的实验结果展示了强化学习在音频推理领域的独特优势,并为未来研究提供了新思路。团队还开源了训练代码、模型参数以及技术报告,便于学术界和产业界进行深入研究与交流。

训练代码: https://github.com/xiaomi-research/r1-aqa

模型参数: https://huggingface.co/mispeech/r1-aqa

技术报告: https://arxiv.org/abs/2503.11197

交互Demo: https://120.48.108.147:7860/

划重点:

🔍 小米大模型团队通过强化学习算法在音频推理领域取得突破,准确率达到64.5%。

📈 MMAU评测集是音频推理能力的重要标准,当前人类专家准确率为82.23%。

💡 研究结果表明,强化学习的实时反馈机制对模型训练更为有效,未来研究仍需深入探索。

暂无评论