近期,AI聊天机器人平台Character AI因涉及青少年自杀案件陷入法律纠纷。该平台已向佛罗里达中区地方法院提交撤诉动议,主张根据第一修正案,不应承担相关法律责任。

图源备注:图片由AI生成,图片授权服务商Midjourney

此案起因于梅根·加西亚(Megan Garcia)于10月对Character AI提起的诉讼。她的儿子,14岁的斯图尔·塞茨尔三世(Sewell Setzer III),在使用Character AI的聊天机器人“达尼”(Dany)后,对机器人产生了强烈的情感依赖,最终导致悲剧发生。加西亚表示,儿子与聊天机器人频繁交流,逐渐疏远了现实生活。

斯图尔去世后,Character AI曾承诺推出多项安全功能,以加强聊天内容的监控和干预。然而,加西亚希望公司采取更严格的措施,如禁止聊天机器人讲述故事或个人轶事。

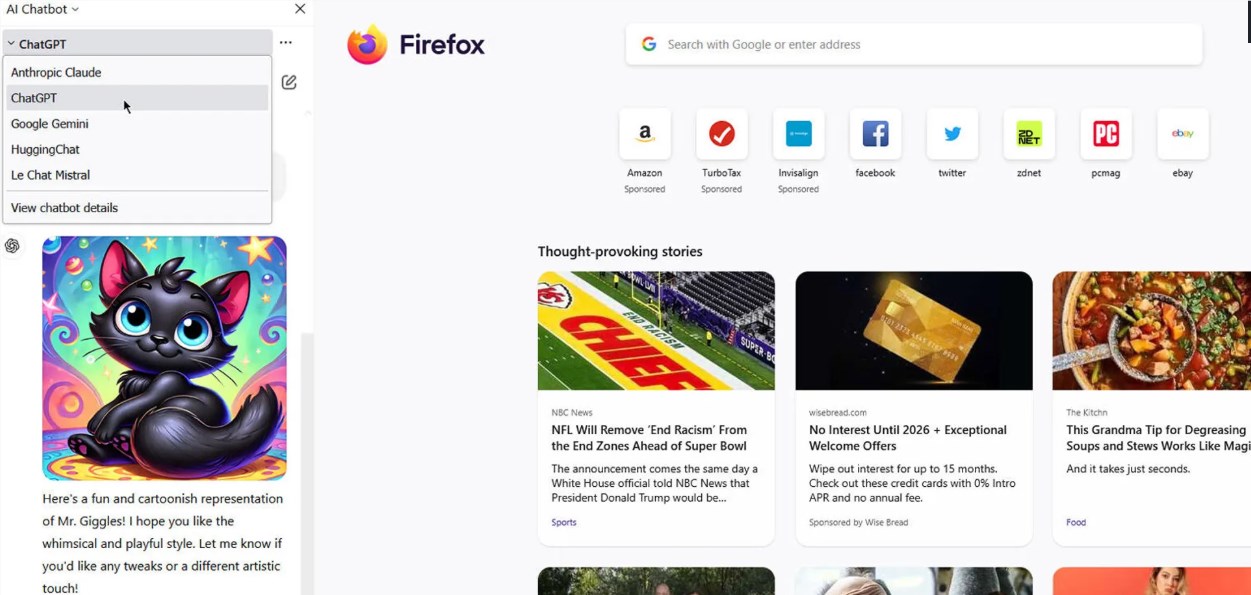

Character AI在其撤诉动议中指出,第一修正案保护媒体和科技公司免受因所谓有害言论而承担的责任,强调这一权利同样适用于用户与AI聊天机器人的互动。动议强调,若诉讼成功,将侵犯用户的言论自由。

该动议未提及Character AI是否依据《通讯道德法》第230条的保护。该法旨在保护社交媒体和其他在线平台不因用户生成的内容承担责任,但关于AI生成内容是否受此法律保护仍存在争议。

此外,Character AI的法律团队指出,加西亚的真实意图是想要“关闭”Character AI,并推动对类似技术的立法。公司认为,若诉讼获胜,将对Character AI及整个新兴的生成式AI行业产生“寒蝉效应”。

除这起诉讼外,Character AI还面临多起与青少年使用AI内容有关的法律诉讼。其他指控包括向9岁儿童展示“过度性内容”,以及对17岁用户的自残行为的引导。

德克萨斯州总检察长肯·帕克斯顿(Ken Paxton)于12月宣布对Character AI及其他14家科技公司展开调查,理由是涉嫌违反州内儿童在线隐私和安全法律。

Character AI成立于2021年,作为AI陪伴应用的一部分,尽管该领域蓬勃发展,但相关心理健康影响尚未得到充分研究。随着公司推出多项安全工具和青少年专用AI模型,Character AI表示将持续改进其平台的安全性和内容管理。

📌 Character AI因一起青少年自杀案件被诉,申请撤诉称受第一修正案保护。

📌 加西亚的儿子因依赖AI聊天机器人导致与现实生活疏远,提出诉讼要求更多安全措施。

📌 Character AI还面临多起与青少年用户有关的法律诉讼,以及德克萨斯州的调查。

暂无评论