近期,谷歌研究院推出了创新性的“Titans”系列模型架构。该架构通过仿生设计实现了200万Token的上下文长度突破,并计划对相关技术进行开源。

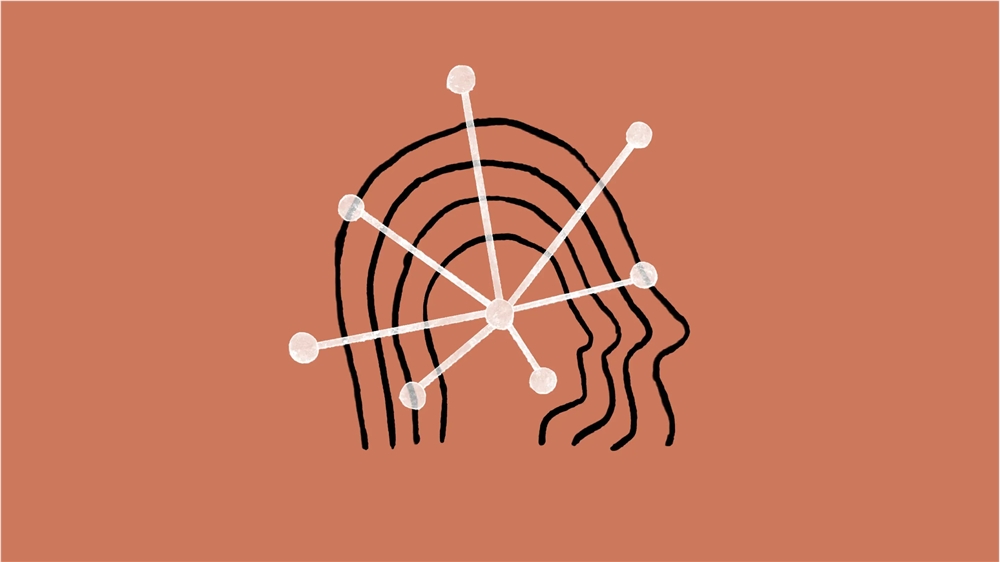

该架构的核心创新点在于引入了深度神经长期记忆模块,这一设计灵感源自人类记忆系统。Titans模型巧妙地结合了短期记忆的快速响应能力和长期记忆的持久性,并通过注意力机制处理即时上下文,构建了一个高效的信息处理机制。

谷歌指出,Titans在长序列处理任务上表现出显著优势。在语言建模和时间序列预测等领域,该架构都取得了突破性的进展。值得注意的是,在某些应用场景中,Titans的表现甚至超越了参数量数十倍的GPT-4等模型。

随着谷歌承诺开源相关技术,Titans的问世有望为AI领域的长文本处理开辟新的发展方向。这种结合生物智能原理的创新设计,展示了在减少模型参数量的同时,提升处理效能的潜力。

暂无评论