Qwen团队近期开源了其最新研发的多模态推理模型QVQ,这一举措标志着人工智能在视觉理解和复杂问题解决领域取得了重要进展。该模型以Qwen2-VL-72B为基础,致力于整合语言与视觉信息,以增强AI的推理能力。在MMMU评测中,QVQ取得了70.3的高分,且在多个数学相关基准测试中,相较于Qwen2-VL-72B-Instruct模型,性能有了显著提升。

QVQ模型在视觉推理任务中表现出卓越的优势,尤其是在需要复杂分析思维的领域中。尽管QVQ-72B-Preview版本表现优异,但团队也指出了模型的一些局限性,包括语言混合、代码切换问题、可能陷入循环逻辑模式、安全与伦理考量,以及性能和基准限制。团队强调,尽管QVQ在视觉推理方面有所改进,但它并不能完全取代Qwen2-VL-72B的功能。在多步骤视觉推理过程中,模型可能会逐渐忽略图像内容,导致产生幻觉。

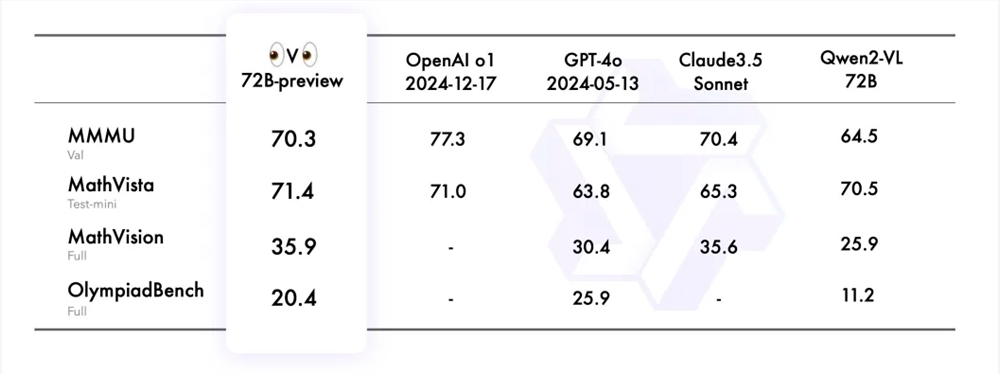

Qwen团队对QVQ-72B-Preview在MMMU、MathVista、MathVision和OlympiadBench四个数据集上进行了评估,这些数据集旨在全面评估模型在视觉理解和推理方面的能力。QVQ-72B-Preview在这些基准测试中表现出色,有效缩小了与领先模型的差距。

为展示QVQ模型在视觉推理任务中的应用,Qwen团队提供了示例,并分享了技术博客链接。此外,团队还提供了模型推理的代码示例,以及如何通过魔搭API-Inference直接调用QVQ-72B-Preview模型的方法。魔搭平台的API-Inference为QVQ-72B-Preview模型提供了支持,用户可以通过API调用直接使用该模型。

模型链接:

https://modelscope.cn/models/Qwen/QVQ-72B-Preview

体验链接:

https://modelscope.cn/studios/Qwen/QVQ-72B-preview

中文博客:

https://qwenlm.github.io/zh/blog/qvq-72b-preview

暂无评论