在全球化的浪潮中,神经机器翻译(NMT)技术正日益成为跨语言交流的关键。虽然现有翻译工具在处理技术文档和简单文本方面表现出色,但在文学作品的翻译上仍存在不少难题。文学作品往往包含丰富的文化隐喻和比喻,传统翻译系统难以准确传达其深层含义。

为了解决这一问题,腾讯研究团队推出了名为 DRT-o1 的新型翻译系统。该系统包括 DRT-o1-7B 和 DRT-o1-14B 两个版本,均基于 Qwen2.5 构建,并采用了一种针对隐喻和比喻翻译的全新多代理框架。研究团队从古登堡项目中选取了约400本公共领域的英语书籍,提取了577,600个句子,并从中筛选出63,000个包含比喻和隐喻的句子作为训练数据。

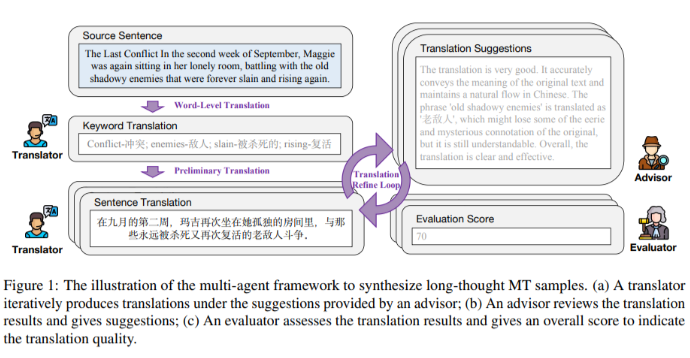

DRT-o1 系统采用了一个由翻译者、顾问和评估者三种角色组成的协作方法。该多代理框架首先识别源句中的关键术语并进行逐个翻译,确保语境准确性。随后,通过多轮改进和评估,最终生成流畅且易于理解的译文。在翻译文学作品时,该系统能够更好地捕捉其文化内涵和情感细腻之处。

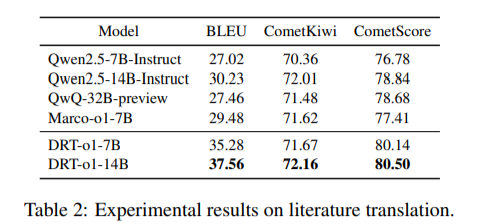

实验结果显示,DRT-o1-7B 的 BLEU 得分提升了8.26分,COMET 得分提升了3.36分,优于其前身 Qwen2.5-7B-Instruct。DRT-o1-14B 同样表现出色,BLEU 得分提升了7.33分,COMET 得分提升了1.66分。这些结果表明,DRT-o1在文学翻译方面的表现超越了现有模型,尤其是其7B 版本甚至超越了更大的 QwQ-32B 模型。

DRT-o1 系统通过引入多代理框架和长链推理方法,为神经机器翻译领域带来了突破性进展。它不仅提高了翻译的准确性和流畅度,更为复杂文学文本的翻译提供了新的解决方案。

项目入口: https://github.com/krystalan/DRT-o1

划重点:

🌟 DRT-o1系统包含两种版本(7B 和14B),采用多代理框架优化隐喻和比喻的翻译。

📚 研究团队从400本公共领域书籍中提取并筛选了63,000个文学句子作为训练数据。

🚀 DRT-o1在 BLEU 和 COMET 得分上均显著提升,展现出强大的文学翻译能力。

暂无评论