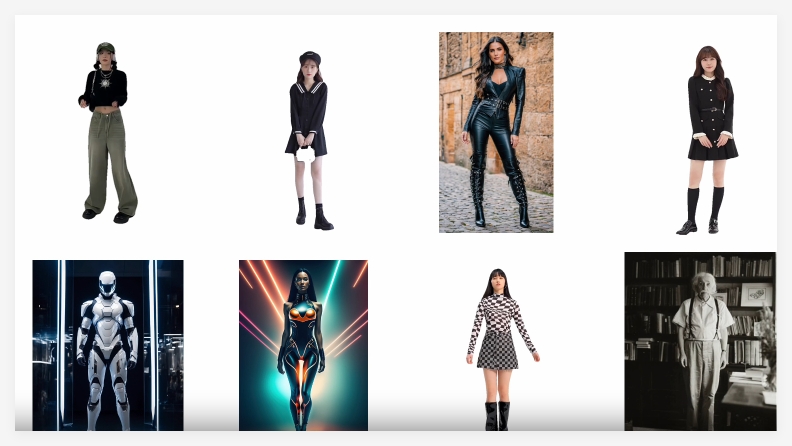

近期,阿里通义实验室推出了一项革命性的技术——LHM(大型可动画人体重建模型),在3D人体重建领域实现了重大突破,为该领域带来了全新的发展机遇和广阔的应用前景。

长久以来,从单张图像进行可动画的3D人体重建一直是一项极具挑战的任务,其中涉及到几何、外观和变形的复杂分离问题。目前,大部分的研究成果都集中在静态人体建模上,这些方法通常依赖于合成的3D扫描数据进行训练,这在很大程度上限制了它们在实际场景中的应用范围。此外,基于视频优化的方法对捕获条件要求严格,计算过程也十分复杂,难以满足实际应用的需求。

LHM模型针对上述问题应运而生,它采用了创新的多元模态变换器架构,并通过高效的注意机制,有效编码人体位置特征和图像特征。这一架构使得LHM不仅能够精确重建人体的几何形状,还能细致地保存服装的几何形状和纹理,为用户呈现更为真实、细腻的3D人体模型。

值得一提的是,LHM还提出了头部特征金字塔编码方案,通过聚合头部区域的多尺度特征,进一步提升了模型对头部细节的捕捉能力,使得生成的3D人体模型在头部表现上更加逼真。在实际应用中,LHM展现出了惊人的效率,能够在几秒钟内生成合理的动画人体,且无需复杂的后期处理,大幅节省了时间和人力成本。

经过大量实验验证,LHM在重建精度和泛化能力方面均优于现有方法。无论是复杂场景还是不同光照条件下,LHM都能稳定输出高质量的3D人体重建结果。

了解更多信息,请访问:https://lingtengqiu.github.io/LHM/

暂无评论