AI21Labs最近推出了其最新款Jamba1.6系列大型语言模型,该模型被誉为市场上性能最强、效率最高的长文本处理工具。与传统Transformer模型相比,Jamba模型在处理长上下文时展现出更高的速度和更优的质量,其推理速度比同类模型提升了2.5倍,标志着技术的重大突破。

Jamba1.6系列包括Jamba Mini(12亿参数)和Jamba Large(94亿参数),这些模型特别针对商业应用进行了优化,支持函数调用、结构化输出(如JSON格式)以及基于现实世界的生成能力。它们的应用领域广泛,从企业级智能助手到学术研究,都能发挥关键作用。

Jamba模型采用Jamba Open Model License开源许可协议,允许用户在遵守相关条款的前提下进行研究和商业使用。Jamba1.6系列的知识截止日期为2024年3月5日,支持包括英语、西班牙语、法语、葡萄牙语、意大利语、荷兰语、德语、阿拉伯语和希伯来语在内的多种语言,满足全球用户的需求。

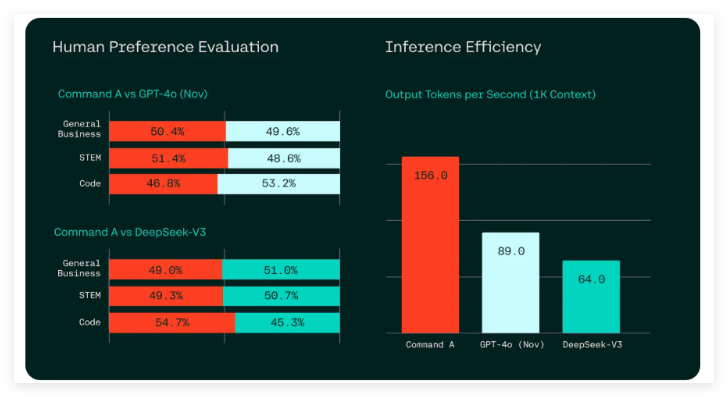

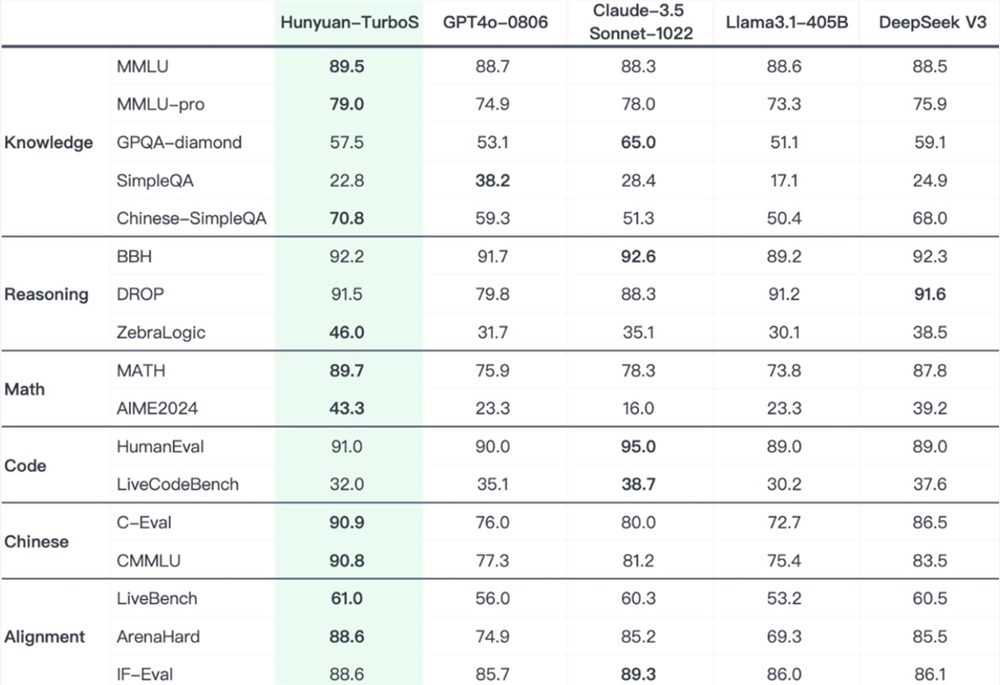

在性能评估方面,Jamba Large1.6在多个基准测试中均表现出色。在Arena Hard、CRAG和FinanceBench等标准测试中,其成绩均超越了同类竞争产品,显示出卓越的语言理解和生成能力。尤其是在处理长文本方面,Jamba模型的表现尤为突出。

为了确保高效的推理,使用Jamba模型的用户需要先安装相应的Python库,并配备CUDA设备以支持模型运行。用户可以通过vLLM或transformers框架来运行该模型。在大规模GPU的支持下,Jamba Large1.6能够处理长达256K的上下文,这是之前模型所无法实现的。

模型链接:https://huggingface.co/ai21labs/AI21-Jamba-Large-1.6

重点提示:

🌟 Jamba1.6模型在长文本处理上速度更快、质量更高,支持多种语言。

🚀 开源许可协议支持研究和商业使用,推动技术共享。

💡 在多项基准测试中表现卓越,超越同类竞争产品。

暂无评论