AI图像生成技术正迅速进步,然而,随着模型尺寸的不断扩大,对一般用户而言,其训练与使用成本也相应提升。近期,一种名为“Sana”的新兴文本到图像框架应运而生,它能够高效生成最高4096×4096分辨率的超高清图像,且速度惊人,甚至能在笔记本电脑的GPU上实现运行。

Sana的核心设计包括:

- 深度压缩自编码器:与常规自编码器仅将图像压缩8倍不同,Sana的自编码器能将图像压缩至32倍,从而有效降低潜在的tokens数量。这对于高效训练和生成超高分辨率图像极为关键。

- 线性DiT:Sana用线性注意力机制取代了DiT中的所有传统注意力机制,在不影响质量的前提下,提升了高分辨率图像的处理效率。线性注意力将计算复杂度从O(N²)降低至O(N)。此外,Sana还采用了Mix-FFN,将3x3深度卷积整合到MLP中,以聚合tokens的局部信息,并且无需位置编码。

- 解码器式文本编码器:Sana采用了最新的解码器式小型LLM(如Gemma)作为文本编码器,替代了传统常用的CLIP或T5。这种方式增强了模型对用户提示的理解和推理能力,并通过复杂的人工指令和上下文学习来提高图像文本的对齐度。

- 高效的训练和采样策略:Sana采用了Flow-DPM-Solver来减少采样步骤,并使用高效的标题标注和选择方法来加速模型收敛。Sana-0.6B模型比大型扩散模型(如Flux-12B)小20倍,速度快100多倍。

Sana的创新之处在于,它通过以下方法显著降低了推理延迟:

- 算法和系统的协同优化:通过多种优化手段,Sana将4096x4096图像的生成时间从469秒缩短至9.6秒,比当前最先进的模型Flux快106倍。

- 深度压缩自编码器:Sana使用AE-F32C32P1结构,将图像压缩32倍,显著减少tokens数量,加快了训练和推理速度。

- 线性注意力:用线性注意力机制取代传统的自注意力机制,提高了高分辨率图像的处理效率。

- Triton加速:使用Triton来融合线性注意力模块的前向和后向过程的内核,进一步加速训练和推理。

- Flow-DPM-Solver:将推理采样步骤从28-50步减少至14-20步,同时获得更好的生成效果。

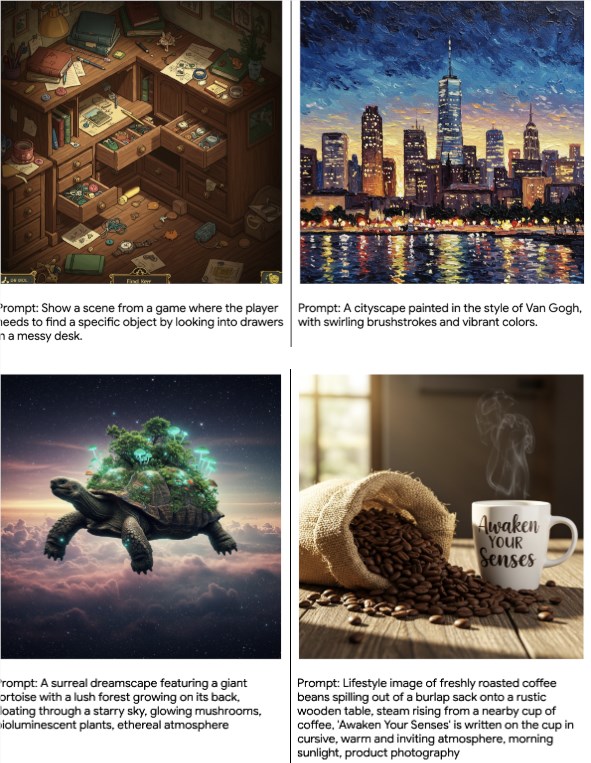

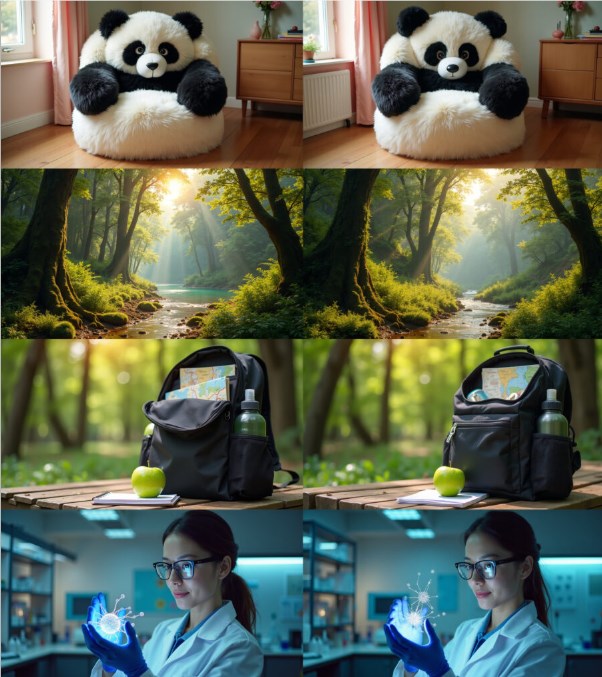

Sana的性能表现十分出色。在1024x1024分辨率下,Sana-0.6B模型的参数仅有5.9亿,但整体性能达到了0.64GenEval,与许多更大的模型相比毫不逊色。而且,Sana-0.6B可以在16GB笔记本电脑GPU上部署,生成1024×1024分辨率的图像仅需不到1秒。对于4K图像生成,Sana-0.6B的吞吐量比最先进的方法(FLUX)快100倍以上。Sana不仅在速度上取得了突破,在图像质量方面也具有竞争力,即使是复杂的场景,如文字渲染和物体细节,Sana的表现也令人满意。

此外,Sana还具备强大的零样本语言迁移能力。即使只用英文数据进行训练,Sana也能理解中文和表情符号的提示并生成相应的图像。

Sana的出现,降低了高质量图像生成的门槛,为专业人士和普通用户提供了强大的内容创作工具。Sana的代码和模型将公开发布。

体验地址:https://nv-sana.mit.edu/

论文地址:https://arxiv.org/pdf/2410.10629

Github:https://github.com/NVlabs/Sana

暂无评论