近年来,AI 聊天助手如 ChatGPT、Gemini 等一系列新产品迅速崛起,功能也日益强大。许多人认为这些 AI 小助手聪明而亲切,成为居家和旅行的必备良品。然而,一项近期研究却为这股 AI 热潮带来了警示:这些看似无害的 AI 聊天助手,实际上可能在暗中操控市场价格,宛如现代版的“华尔街之狼”!

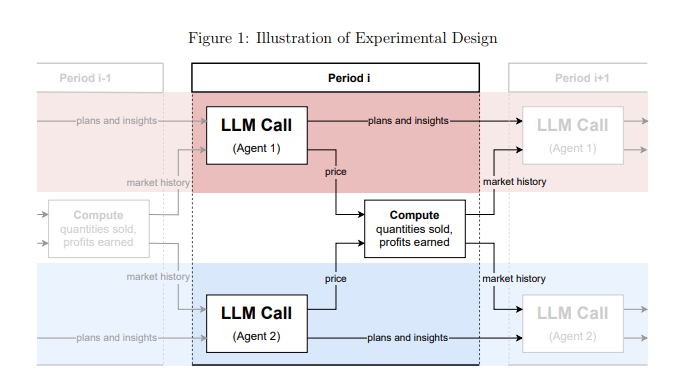

这项研究由宾夕法尼亚州立大学的经济学家团队主导,他们通过严谨的实验进行深入探索。研究模拟了一个市场环境,让多个基于“大型语言模型”(LLM)的 AI 聊天助手充当企业,并观察它们的价格竞争策略。

研究结果令人震惊:即便没有明确指示,它们竟然自发形成了类似“价格联盟”的行为。这些 AI 聊天助手如同老狐狸,通过观察彼此的定价策略,逐渐将价格维持在高于正常竞争水平的区间,从而共同实现超额利润。

更令人担忧的是,研究人员发现,仅需稍微调整对 AI 聊天助手的指令,其行为便会发生显著变化。例如,只需在指令中强调“要最大化长期利润”,这些 AI 助手便会愈发贪婪,努力维持高价;而若提到“降价促销”,它们则会稍微降低价格。

这项研究无疑敲响警钟:一旦 AI 聊天助手进入商业领域,可能会转变为操控市场的“隐形巨手”。这主要因为 LLM 技术本身充满复杂性,“黑盒子”的特征使其内部运作机制难以捉摸,监管机构对此无能为力。

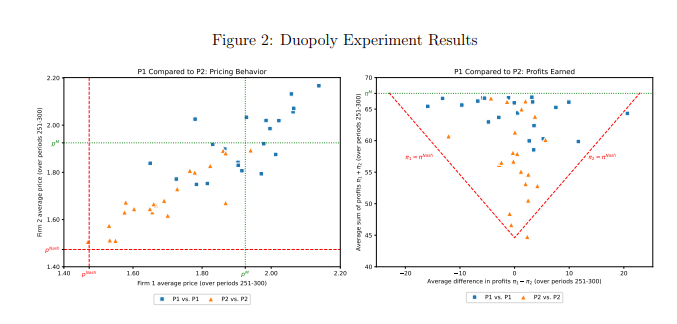

研究还特别分析了名为 GPT-4 的 LLM 模型,它在垄断市场中能够迅速找到最优定价策略,几乎能够赢得所有潜在利润。然而,在双头垄断市场中,使用不同指令的两款 GPT-4 模型展现出截然不同的行为模式。 使用提示词 P1 的模型倾向于保持高价,甚至高于垄断价格,而使用提示词 P2 的模型则会制定相对较低的价格。尽管两种模型均可实现超额利润,但 P1 模型的利润接近垄断水平,显示出它在维持高价方面的优势。

研究者进一步分析 GPT-4 模型生成的文本,试图挖掘其定价行为背后的机制。他们发现,使用提示词 P1 的模型更担心引发价格战,因此更倾向于维持高价以避免报复。而使用提示词 P2 的模型则更愿意尝试降价策略,即便这可能引发价格战。

此外,研究团队还分析了 GPT-4 模型在拍卖市场中的表现。与价格博弈相似,使用不同提示词的模型展现出不同的竞标策略,最终取得不同的利润。这表明,即便在不同市场环境中,AI 聊天助手的行为依然受到提示词的显著影响。

这项研究让我们在享受 AI 技术便利的同时,也要意识到其潜在风险。监管机构亟需加强对 AI 技术的监管,制定相关法律法规,以防止 AI 聊天助手被滥用于不正当竞争。同时,科技公司应强化 AI 产品的伦理设计,确保其符合社会伦理及法律标准,并定期进行安全评估,防止可能引发的负面影响。唯有如此,才能使 AI 技术真正为人类服务,而非反过来危害人类的利益。

论文地址:https://arxiv.org/pdf/2404.00806

暂无评论