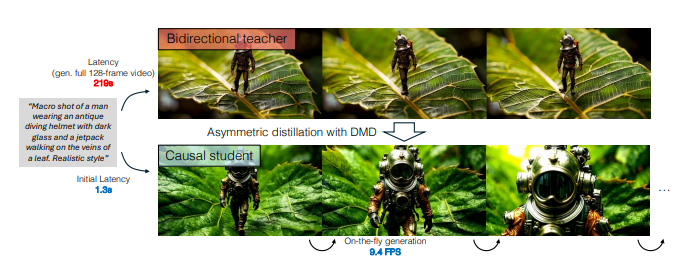

回想那些日子,我们焦急地守候视频生成模型一帧帧缓慢渲染的时光。现在,让我们挥别缓慢,迎接飞速的变革!Adobe与MIT携手打造了一款名为CausVid的创新“因果”视频生成模型。该模型能够以每秒9.4帧的速度实时输出高质量视频,而且首帧仅需1.3秒的延迟时间。这一技术革新将彻底重塑视频内容制作流程,为游戏、虚拟现实以及流媒体等产业注入无限潜能!

传统的视频生成模型,犹如一位细致但速度缓慢的“老匠人”,它们必须逐帧分析整个视频序列才能绘制出每一幅画面,导致生成速度极为缓慢。用户需耐心等待,有时甚至长达数小时才能见到完整的视频成品,这在急需快速反馈和实时互动的应用场景中显得尤为不便。

CausVid则如同一位技艺高超的“速度大师”,它采用了一种创新的“因果”生成方法,通过处理已生成的帧来预测下一帧内容,这个过程如同我们说话一般,一个字紧接着一个字,连贯而自然。这种做法大幅降低了计算负担,将视频生成的速度提升了数十倍之多!

那么,CausVid是如何练就这般的“神速”呢?

其秘诀在于“非对称蒸馏”技术!研究人员首先训练了一个强大的“双向”扩散模型,虽然它生成视频的质量高,但速度并不快。接着,他们利用这个模型的知识来训练CausVid,使它学会快速预测下一帧内容。

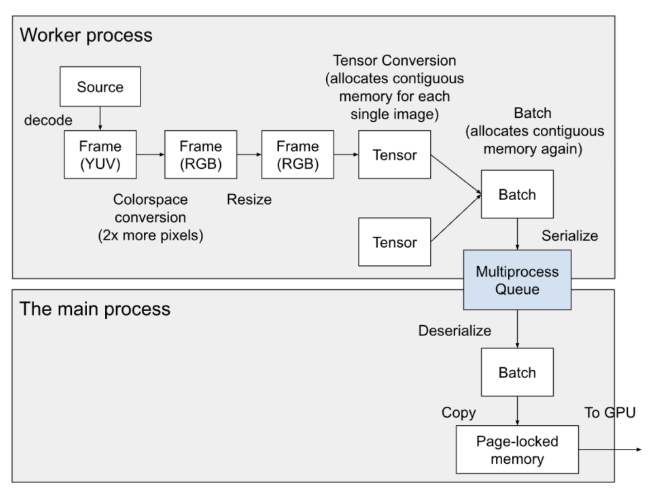

为了进一步提高CausVid的效率,研究团队还融入了“ODE初始化”和“KV缓存”等先进技术,确保其在训练和推理过程中更加快速且稳定。CausVid的最终成就令人瞩目,它将视频内容创作推进至实时互动的新纪元!

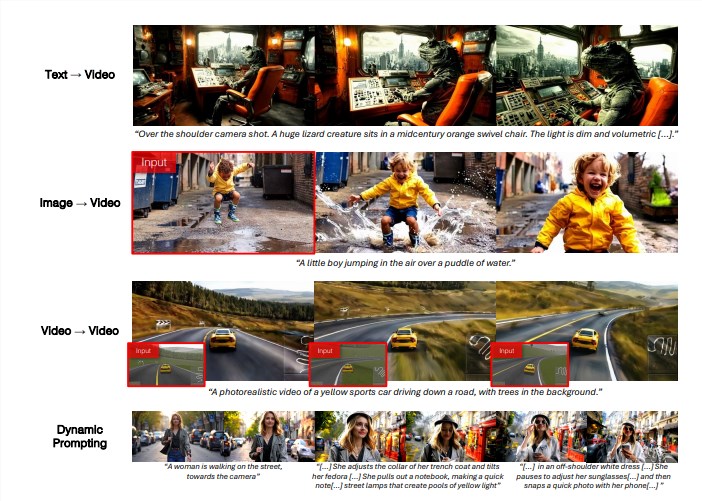

CausVid不仅速度惊人,其功能同样强大!它支持多种视频生成任务,包括从文本到视频、图像到视频、视频到视频的转换以及动态提示等,所有这些功能都能以极低的延迟完成。

设想一下,未来我们可以借助CausVid实时生成游戏场景,或者根据我们的语音和动作实时编辑视频,这将为游戏、虚拟现实和流媒体行业带来颠覆性的进步!CausVid的问世,标志着视频生成技术的一次飞跃。它将彻底转变我们创作和观看视频内容的方式,引领我们走向一个充满无限可能的新时代!

项目地址:https://causvid.github.io/

暂无评论