近期,在备受瞩目的全球人工智能顶级学术盛会AAAI2025上,蚂蚁集团、浙江大学、利物浦大学以及华东师范大学的研究团队共同提出了一种新型的跨域微调(offsite-tuning)框架——ScaleOT。该框架在确保模型性能不受损的前提下,能够将隐私保护效果提升至原来的50%,相比知识蒸馏技术,算力消耗减少了高达90%,为大规模参数模型的跨域微调提供了高效且轻量化的解决方案。这一创新性论文成功入选AAAI的oral论文,在本次大会上,约13000篇投稿中仅有4.6%的作品能获得口头报告的机会。

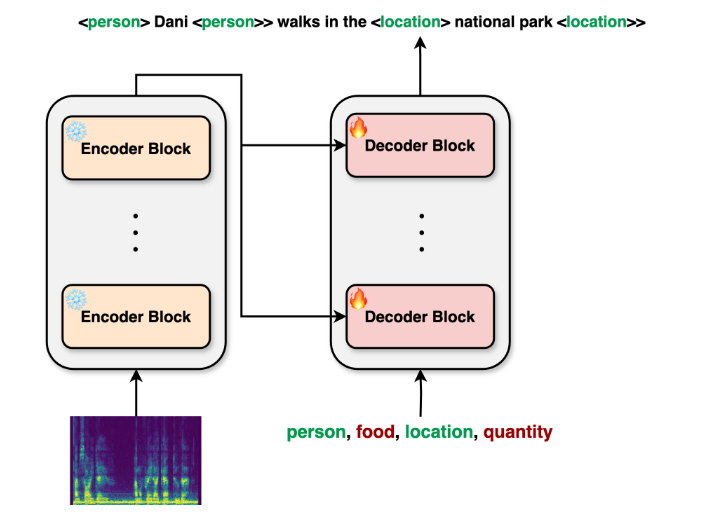

跨域微调是目前行业内保护模型产权和数据隐私的主要手段。它通过有损压缩将大型模型转换为仿真器,数据所有者利用其训练适配器进行调优,同时保证数据和模型不离开各自领域,以此保护双方的隐私。然而,这种方法存在一定的局限性:首先,其“均匀抽积木”式的处理方法容易导致模型关键层的缺失,从而显著降低性能;其次,使用蒸馏技术来弥补性能损失会导致计算成本高昂;再者,现有方法的隐私保护缺乏灵活性。

蚂蚁集团的技术团队介绍,ScaleOT框架提出了三大创新点,以平衡模型性能和隐私安全。首先,它通过强化学习技术评估大型模型智能层的重要性,自动识别关键层,并动态保留这些“核心层”,以减少性能损失;其次,对保留的原始层进行编码处理,防止攻击者还原原始模型,从而在几乎不影响性能的前提下提升隐私保护强度;最后,可根据不同的应用场景灵活组装,实现隐私强度的调节。

解决大模型的数据和模型隐私安全问题,是其在产业界尤其是金融行业落地的重要课题。蚂蚁集团推出的这一创新算法已应用于其旗下的摩斯大模型隐私保护产品中,并且是国内首批通过信通院大模型可信执行环境产品专项测试的产品之一。

暂无评论